AI音声を詐欺に悪用

2023年9月11日、人工知能(AI)で人間の声を合成する「ディープフェイクボイス」を悪用した詐欺への懸念がアメリカなど海外で高まっているというニュースがありました。

AI音声を詐欺に悪用 3秒の素材合成、親族らそっくりに – 日本経済新聞 https://t.co/pCsJIwcUZn

— 満州中央銀行 (@kabutociti) September 10, 2023

人工知能(AI)とは?

人工知能(AI)は、Artificial Intelligence:アーティフィシャル・インテリジェンスといい、1956年に米国の計算機科学研究者ジョン・マッカーシーが初めて使った言葉です。人工知能(AI)について、総務省のサイトより、ご紹介します。

「AI」に関する確立した定義はありませんが、人間の思考プロセスと同じような形で動作するプログラム、あるいは人間が知的と感じる情報処理・技術といった広い概念で理解されされています。

出典)総務省のサイト:https://www.soumu.go.jp/hakusho-kids/use/economy/economy_06.html

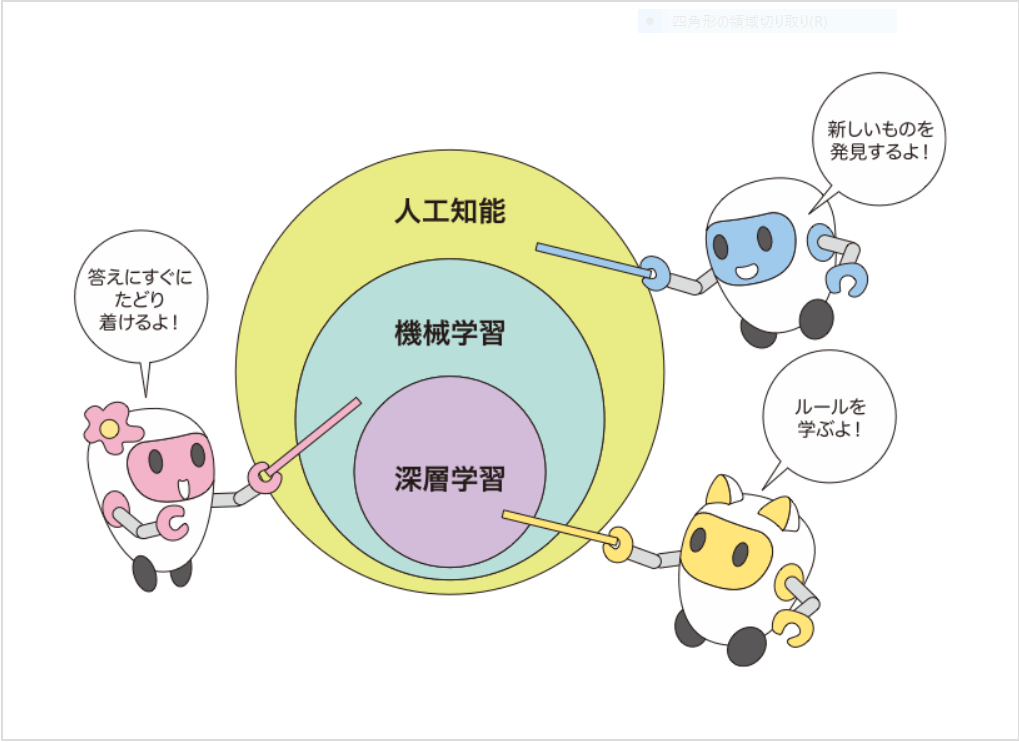

「AI」という言葉だけではなく、最近では「機械学習」、「深層学習(ディープラーニング)」といった言葉もよく使われていて、この3つの言葉は下の図のような関係になっています。

出典)総務省のサイト:https://www.soumu.go.jp/hakusho-kids/use/economy/economy_06.html

参考)総務省のサイト:https://www.soumu.go.jp/hakusho-kids/use/economy/economy_06.html

「ディープフェイク」とは?

「ディープフェイク」は、「ディープラーニング」と「フェイク」を組み合わせた造語で、人口知能(AI)を用いて、人物の動画や音声を人工的に合成する処理技術を指しもともとは映画製作など、エンターテインメントの現場での作業効率化を目的に開発されたものですが、あまりにリアルで高精細であることから、悪用されるケースが増えたことで、昨今ではフェイク(ニセ)動画の代名詞になりつつあるそうです。

「ディープフェイクボイス」は、ディープフェイクを使用した音声のことで、特定の人が言っていないことを言っているかのように聞こえる、説得力のある音声文を作成するために使用される人工知能(AI)のひとつです。

AI音声での悪用事例

アメリカ連邦取引委員会(FTC)によると、家族や友人を装った電話による詐欺は2022年で約5000件に上り、AI悪用の件数はわからないが、悪用された可能性が高い事例もあるそうです。中国でもAIを活用した詐欺が増加していて、警察当局が警戒を呼びかけているとのことです。

AI音声での悪用事例をいくつかご紹介します。

3秒間のサンプルで超有名俳優の声を合成! 世界中で多発するAI音声詐欺|東スポWEB https://t.co/RJNV8Mjd8X

— 東スポ (@tospo_prores) May 15, 2023

AI音声を使った”詐欺” 世界で急増

インド人の47%がAI音声詐欺を経験TBS#ひるおび

5/24/2023 pic.twitter.com/QWp2OsC4hT

— RING 🇯🇵 #Investor #Trader (@xRINGx) May 24, 2023

偽装NTTファイナンスからのAI音声詐欺電話が

私のスマホにも着信〜電話番号はロボットが数字を

機械的に掛け合わせて発信するので私の電話番号を

詐欺グループは知らない「料金未納のお知らせです〜

〇〇◯○に電話してください」と言われて電話すると

電話番号が詐欺グループに知られるので☜御用心— 牧野尚人makino takahito (@tkmakino) May 14, 2023

みんなの反応・SNSの反応

AI音声を詐欺に悪用についてのSNS(Twitter等)での反応をいくつかご紹介します。なりすまし詐欺が急増や3秒でAI音声ができることへの驚きや詐欺に注意などの声がありました。

AI音声でなりすまし詐欺急増 #SmartNews https://t.co/NbRs8lfAMO

— 秀虎 (@hidetora_f) October 9, 2023

わずか3秒の音声データでAI学習ができるとは驚きです💦

最新技術を詐欺師は巧みに利用します🔥#AIオレオレ詐欺 にご注意ください💡 https://t.co/2FyRYhYUU5— スルガ姫/不動産物語 (@SurugaEstate) October 7, 2023

AIで音声を真似ることができるので、声だけで信用できない世の中になっています❗️AIが悪用されない様にできないものかと思ってしまいます🤔#AIオレオレ詐欺

【ガチョ~ン】 AIオレオレ詐欺 の手口とは! #詐欺 #改ざん https://t.co/SJ72WDhvUt @YouTubeより

— 最終兵器 (@GSX_R1000_KS) October 7, 2023

https://twitter.com/serendi07513792/status/1708124675333935406世界中で特殊詐欺は進化し続けてるけど、こんな犯罪を行う技術も、犯罪者を特定することもできるくらい日本はもうすでに監視社会だって、早く公表すれば良いのにね。

AIで偽音声、詐欺に悪用 「遭遇8割で被害」調査も – 日本経済新聞 https://t.co/yc5sn4RyXb

— 大山郁子 (@ichik0x0) October 2, 2023

コメント